El Parlamento Europeo vota la aprobación de la primera normativa completa sobre IA. He aquí un breve resumen de la Ley de IA, cuya influencia se extenderá probablemente más allá de la UE.

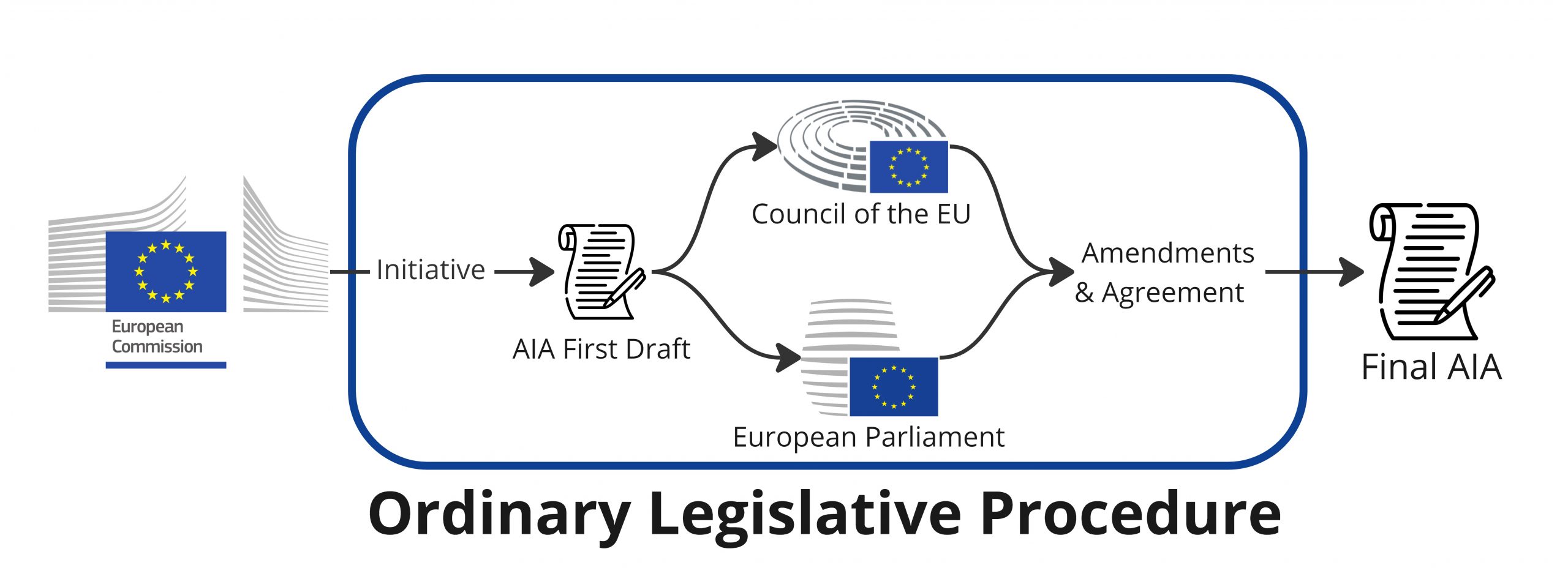

El Parlamento Europeo ha votado ayer a favor de sacar adelante la primera legislación exhaustiva sobre inteligencia artificial, conocida como Ley de IA.

Es el primer paso de un proceso que culminará a finales de este año, cuando se espera que se apruebe una versión final de la ley, informa The New York Times. Esto consolidaría a Europa como modelo mundial de regulación tecnológica, como ha ocurrido, por ejemplo, con la privacidad de los datos.

«Hoy hemos hecho historia», afirma Brando Benifei, miembro italiano de la Comisión Europea, autora de la Ley de Inteligencia Artificial, según informa The Washington Post. Benifei afirma que los legisladores europeos «marcarán el camino» al resto del mundo en materia de «IA responsable».

La Comisión Europea comenzó a redactar la propuesta de 108 páginas en 2021, con mayor urgencia desde el explosivo lanzamiento de ChatGPT en otoño de 2022, así como los competidores de Google, Microsoft y creadores de imágenes como Dall-E y Midjourney.

EE.UU. aún no ha aprobado una legislación similar, optando por enfoques más suaves como la Ley de Iniciativa Nacional de Inteligencia Artificial (2020) y la Declaración de Derechos de la IA (octubre de 2022).

En una audiencia del Senado sobre IA celebrada el mes pasado, el CEO de OpenAI, Sam Altman, instó al Congreso a actuar e implantar regulaciones más estrictas para mitigar el daño potencial de estos potentes y opacos sistemas. El presidente de Microsoft, Brad Smith, también pidió a EE.UU. y a otros países que establezcan sus propias agencias gubernamentales dedicadas a regular la IA.

¿Qué contiene la Ley de IA de la UE?

La Ley de IA define la inteligencia artificial como el software que puede, «para un conjunto dado de objetivos definidos por el ser humano, generar resultados como contenidos, predicciones, recomendaciones o decisiones que influyan en los entornos con los que interactúan» y a continuación esboza los ideales y normativas que deben cumplir los sistemas de «alto riesgo», así como sus usuarios.

Estipula que, antes de su lanzamiento público, los sistemas de alto riesgo deben someterse a una evaluación para garantizar que cumplen la normativa y que están diseñados para reducir el riesgo mediante «un diseño y desarrollo adecuados». En cuanto a los modelos de IA que siguen «aprendiendo» tras su lanzamiento inicial, como ChatGPT, exige un «sistema de seguimiento postcomercialización» para vigilar, documentar y notificar los cambios significativos y cualquier problema.

En cuanto a los datos, los creadores de modelos de IA deben revelar las fuentes de información protegida por derechos de autor que sus sistemas utilizan para generar resultados. También limita el «uso y el tratamiento de los datos biométricos implicados de forma exhaustiva», sobre todo en la tecnología de reconocimiento facial.

Los sistemas que cumplan la normativa deberán mostrar al público un distintivo de la Comisión Europea como muestra de su conformidad. La propuesta también crea un Consejo Europeo de Inteligencia Artificial.

Aunque la ley se centra en las empresas que crean modelos de IA (y se benefician de ellos), también incluye algunas disposiciones para que el público limite la difusión de información errónea. Por ejemplo, exige a cualquiera que utilice IA para crear un deepfake convincente de otra persona en imagen, audio o vídeo, que revele «que el contenido ha sido creado o manipulado artificialmente etiquetando la salida de inteligencia artificial en consecuencia y revelando su origen artificial».

Making pictures of Trump getting arrested while waiting for Trump’s arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins) March 20, 2023

Al mismo tiempo, la ley reconoce el «amplio abanico de beneficios económicos y sociales» de la IA. Su objetivo es «fomentar la innovación en IA estableciendo un entorno controlado de experimentación y pruebas en la fase de desarrollo y previa a la comercialización.»

Sin embargo, el proyecto de ley es lo suficientemente restrictivo como para que en un momento dado Altman dijera que OpenAI cesaría sus operaciones en Europa si se aprobaba, aunque más tarde se retractó.

¿Escritor fantasma americano?

A veces, la retórica de la Ley de IA parece invocar los ideales estadounidenses de libertad personal y privacidad. Califica el uso del reconocimiento facial basado en IA para el cumplimiento de la ley en espacios públicos de «especialmente intrusivo para los derechos y libertades de las personas afectadas, en la medida en que puede afectar a la vida privada de una gran parte de la población [y] evocar una sensación de vigilancia constante».

La libertad de pensamiento es otro de los puntos centrales del proyecto de ley. Prohíbe los sistemas de IA que «despliegan técnicas subliminales más allá de la conciencia de una persona para distorsionar materialmente su comportamiento». También exige que los sistemas que utilizan IA notifiquen a las personas que están interactuando con un sistema de IA, a menos que sea «obvio por las circunstancias», así como cuando se exponen a un modelo que registra y procesa datos emocionales y biométricos.